L’intelligence artificielle (IA) est une technologie puissante, mais sa neutralité dépend de l’usage qu’on en fait. Une récente démonstration a choqué le public : un robot capable de tirer avec un fusil d’assaut, conçu par un amateur utilisant ChatGPT, a fait le tour des réseaux sociaux, soulevant de graves inquiétudes.

Un robot inquiétant conçu par un particulier

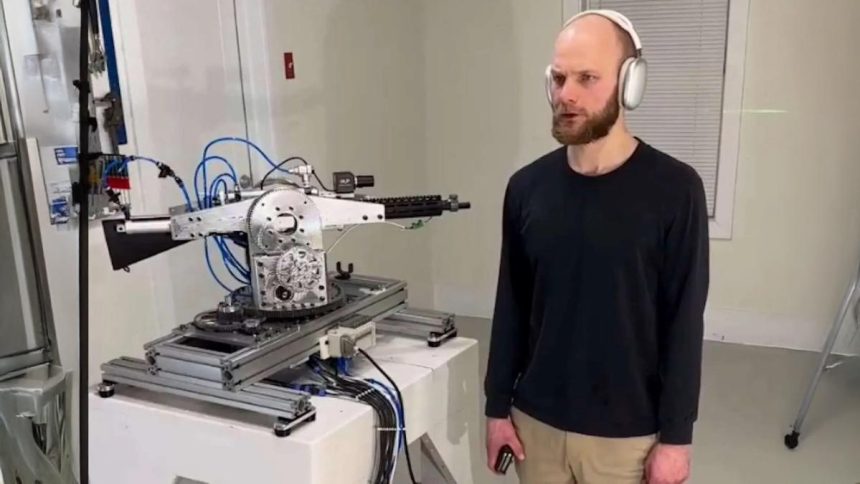

La vidéo à l’origine de la polémique a été publiée par une personne utilisant le pseudonyme STS 3D. On y voit un robot, contrôlé via l’API d’OpenAI, exécuter des commandes vocales pour tirer avec précision. La machine, équipée d’une voix synthétique répondant de manière troublante aux ordres, tire des rafales en visant des cibles identifiées comme des “menaces”. La scène a immédiatement suscité des débats sur les dangers des IA accessibles au grand public.

Cette innovation inquiétante repose sur une combinaison entre l’IA générative et une structure robotisée complexe, capable d’actionner une arme à feu. Le robot s’illustre par son obéissance froide et mécanique, répondant par des phrases telles que : « Comment puis-je vous aider ? », avant d’ouvrir le feu.

L’utilisation militaire et les dérives

L’utilisation de ChatGPT à des fins violentes est contraire aux règles d’OpenAI. Cependant, l’entreprise a récemment assoupli sa position sur l’usage militaire de ses technologies, une décision qui alimente aujourd’hui la controverse. Bien qu’OpenAI ait rapidement désactivé l’accès de STS 3D à son IA après la diffusion de la vidéo, le mal était déjà fait. La démonstration montre qu’un particulier, sans ressources militaires ni institutionnelles, peut transformer une IA en arme redoutable.

STS 3D n’a pas précisé comment il a réussi à intégrer l’IA pour en faire un outil de combat, mais son initiative met en lumière un problème majeur : des technologies autrefois réservées aux grandes puissances sont désormais à portée de simples amateurs. Cela soulève des questions urgentes sur la réglementation et le contrôle des IA à des fins potentiellement destructrices.

Des implications inquiétantes

Si des robots armés pilotés par des IA existent déjà dans les arsenaux de certaines nations, ce cas particulier choque par sa simplicité et son accessibilité. Il illustre à quel point des outils puissants peuvent être détournés par des individus isolés. Ce nouvel exemple rappelle l’urgence de renforcer les garde-fous autour des technologies d’IA, avant que de telles innovations ne se multiplient hors de tout contrôle.

La controverse autour de cette vidéo met une fois de plus en lumière les dangers de l’IA entre des mains mal intentionnées. L’équilibre entre progrès technologique et sécurité reste plus fragile que jamais.

La Rédaction